Tìm hiểu Định nghĩa về Máy chủ Deep Learning là gì?

Trong cuộc cách mạng trí tuệ nhân tạo, nếu thuật toán là linh hồn thì máy chủ Deep Learning (Học sâu) chính là cơ bắp. Để huấn luyện một mô hình ngôn ngữ lớn hay một hệ thống nhận diện hình ảnh phức tạp, bạn không thể chỉ dựa vào những chiếc máy tính văn phòng thông thường. Vậy máy chủ Deep Learning cần những tiêu chuẩn gì? Làm sao để xây dựng một hệ thống vừa mạnh mẽ, vừa bền bỉ? Hãy cùng tìm hiểu chi tiết.

Khác với máy chủ thông thường, máy chủ Deep Learning tập trung vào việc xử lý các phép toán ma trận và tensor – vốn là nền tảng của các mô hình AI như CNN (Mạng thần kinh tích chập), RNN (Mạng thần kinh tái phát) hay Transformer.

Câu trả lời nằm ở cấu trúc:

Nếu bạn đang bắt đầu, hãy tập trung vào một GPU mạnh mẽ và một bộ khung (Chassis) có khả năng nâng cấp về sau. AI là một cuộc đua đường dài, và máy chủ chính là phương tiện đưa bạn về đích nhanh nhất.

Tìm hiểu thêm tại đây: https://aiotvn.com/may-chu-deep-learning/

Trong cuộc cách mạng trí tuệ nhân tạo, nếu thuật toán là linh hồn thì máy chủ Deep Learning (Học sâu) chính là cơ bắp. Để huấn luyện một mô hình ngôn ngữ lớn hay một hệ thống nhận diện hình ảnh phức tạp, bạn không thể chỉ dựa vào những chiếc máy tính văn phòng thông thường. Vậy máy chủ Deep Learning cần những tiêu chuẩn gì? Làm sao để xây dựng một hệ thống vừa mạnh mẽ, vừa bền bỉ? Hãy cùng tìm hiểu chi tiết.

1. Máy chủ Deep Learning là gì?

Máy chủ Deep Learning là một hệ thống máy tính hiệu năng cao (HPC) được thiết kế đặc biệt để xử lý các thuật toán mạng thần kinh nhân tạo (Artificial Neural Networks). Đặc điểm quan trọng nhất của dòng máy chủ này là khả năng tính toán song song cực mạnh, chủ yếu dựa vào sức mạnh của các bộ xử lý đồ họa (GPU).Khác với máy chủ thông thường, máy chủ Deep Learning tập trung vào việc xử lý các phép toán ma trận và tensor – vốn là nền tảng của các mô hình AI như CNN (Mạng thần kinh tích chập), RNN (Mạng thần kinh tái phát) hay Transformer.

2. Các thành phần quan trọng nhất trong máy chủ Deep Learning

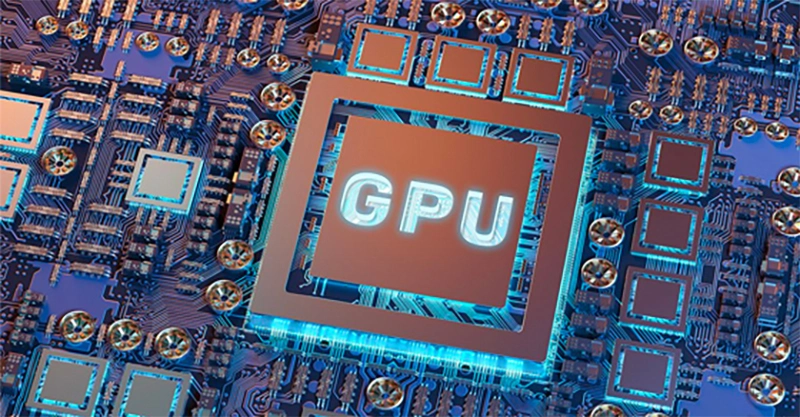

Để xây dựng một hệ thống "chiến" cho AI, bạn cần đặc biệt lưu ý đến 4 thành phần sau:2.1. Bộ xử lý đồ họa (GPU) - "Trái tim" của hệ thống

GPU là thành phần quan trọng nhất. Trong Deep Learning, số lượng nhân (cores) và băng thông bộ nhớ của GPU quyết định tốc độ huấn luyện mô hình.- Lựa chọn hàng đầu: NVIDIA vẫn thống trị với các dòng H100, H200 (Blackwell) hoặc dòng phổ thông hơn như RTX 6000 Ada.

- Lưu ý: Hãy ưu tiên các GPU có dung lượng VRAM lớn (từ 24GB trở lên) để có thể nạp các bộ dữ liệu (dataset) lớn vào bộ nhớ.

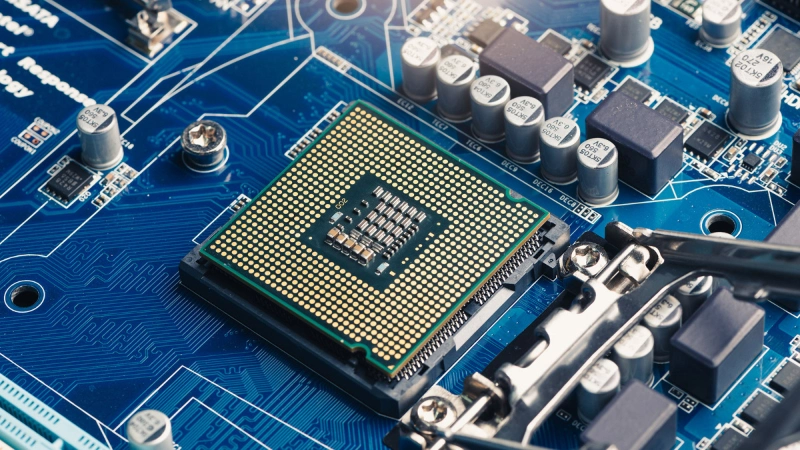

2.2. Bộ vi xử lý (CPU) - "Người điều phối"

Dù GPU làm nhiệm vụ tính toán chính, nhưng CPU vẫn đóng vai trò quan trọng trong việc xử lý dữ liệu đầu vào (Pre-processing).- Khuyến nghị: Sử dụng CPU có nhiều làn PCIe (PCIe Lanes) như AMD EPYC hoặc Intel Xeon Scalable. Điều này giúp dữ liệu di chuyển giữa CPU và nhiều GPU mà không bị nghẽn cổ chai.

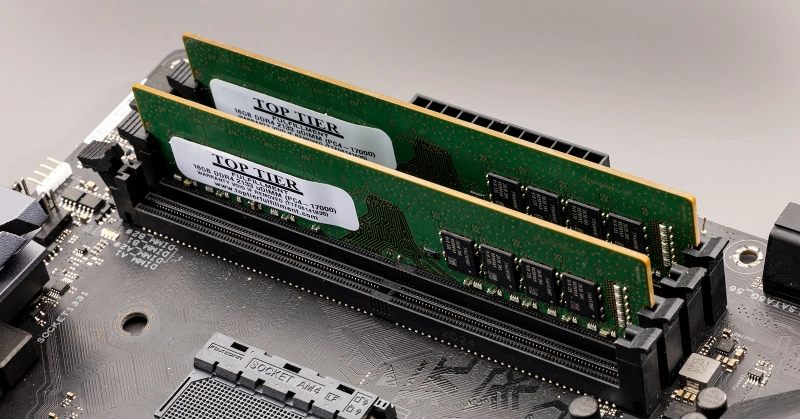

2.3. Bộ nhớ RAM

RAM của máy chủ Deep Learning nên lớn gấp ít nhất 2 lần tổng dung lượng VRAM của tất cả các GPU cộng lại. Điều này đảm bảo hệ thống luôn có đủ không gian để lưu trữ dữ liệu tạm thời trước khi đẩy vào GPU.2.4. Lưu trữ (Storage)

Tốc độ đọc/ghi dữ liệu ảnh hưởng trực tiếp đến thời gian training. Bạn nên sử dụng ổ cứng NVMe SSD để đảm bảo dữ liệu được cung cấp cho GPU nhanh nhất có thể.

3. Tại sao Deep Learning cần GPU thay vì CPU?

Một câu hỏi phổ biến là: "Tại sao không dùng nhiều CPU thay cho GPU?".Câu trả lời nằm ở cấu trúc:

- CPU: Được thiết kế để xử lý tuần tự các tác vụ phức tạp (vài chục lõi cực mạnh).

- GPU: Được thiết kế để xử lý song song hàng triệu tác vụ đơn giản (hàng nghìn lõi nhỏ).

4. Các loại máy chủ Deep Learning phổ biến

Tùy vào quy mô dự án, bạn có thể lựa chọn các hình thức sau:4.1. Máy chủ Workstation (Trạm làm việc)

Phù hợp cho các cá nhân, nghiên cứu sinh hoặc startup nhỏ. Thiết kế dạng tháp (Tower), có thể đặt ngay tại văn phòng và không quá ồn.4.2. Máy chủ Rackmount chuyên dụng

Dành cho các doanh nghiệp và trung tâm dữ liệu. Các dòng máy chủ từ ASUS, Lenovo, MSI hay Supermicro hỗ trợ từ 4 đến 10 GPU trong một khung máy 4U, mang lại mật độ tính toán cực cao.

4.3. Máy chủ Deep Learning trên đám mây (Cloud AI)

Các dịch vụ như Google Colab, AWS, hay Azure cho phép bạn thuê GPU theo giờ. Đây là giải pháp tiết kiệm nếu bạn không có nhu cầu huấn luyện thường xuyên.5. Những thách thức khi vận hành máy chủ Deep Learning

- Nhiệt năng: Các GPU chạy hết công suất tỏa nhiệt rất lớn. Nếu không có hệ thống tản nhiệt nước hoặc phòng máy lạnh chuyên dụng, tuổi thọ linh kiện sẽ giảm nhanh chóng.

- Điện năng: Một máy chủ gắn 8 GPU H100 có thể tiêu thụ tới $5kW - 10kW$ điện. Bạn cần một hệ thống điện lưới ổn định và bộ lưu điện (UPS) công suất lớn.

- Phần mềm: Cài đặt Driver, CUDA, cuDNN và các thư viện như PyTorch, TensorFlow cần sự đồng nhất về phiên bản để tránh xung đột hệ thống.

6. Xu hướng máy chủ Deep Learning năm 2026

Năm 2026, chúng ta thấy sự chuyển dịch mạnh mẽ sang các hệ thống Liquid Cooling (tản nhiệt chất lỏng) trực tiếp vào chip để tối ưu hiệu suất. Ngoài ra, việc sử dụng các cấu trúc kết nối tốc độ cao như NVLink thế hệ mới giúp các GPU trong máy chủ trao đổi dữ liệu trực tiếp mà không cần đi qua CPU, giúp tăng tốc độ xử lý lên gấp nhiều lần.

Kết luận

Đầu tư vào một máy chủ Deep Learning là đầu tư vào tương lai của doanh nghiệp trong kỷ nguyên AI. Một hệ thống được cấu hình đúng không chỉ giúp bạn tiết kiệm thời gian huấn luyện mô hình mà còn mở ra những khả năng sáng tạo mới trong việc xử lý dữ liệu và tự động hóa.Nếu bạn đang bắt đầu, hãy tập trung vào một GPU mạnh mẽ và một bộ khung (Chassis) có khả năng nâng cấp về sau. AI là một cuộc đua đường dài, và máy chủ chính là phương tiện đưa bạn về đích nhanh nhất.

Tìm hiểu thêm tại đây: https://aiotvn.com/may-chu-deep-learning/